Objectdetectie: Aanpasbare deep-learning modellen voor machine vision

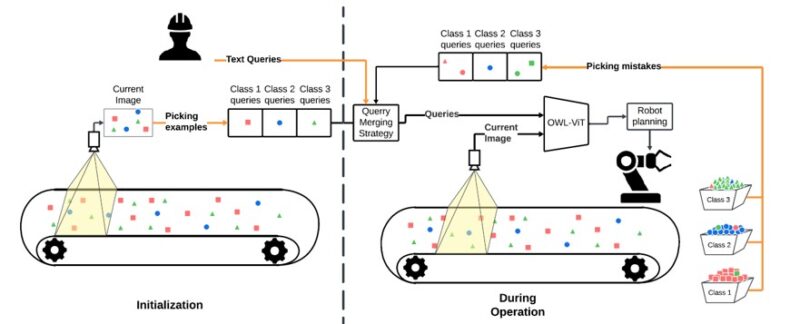

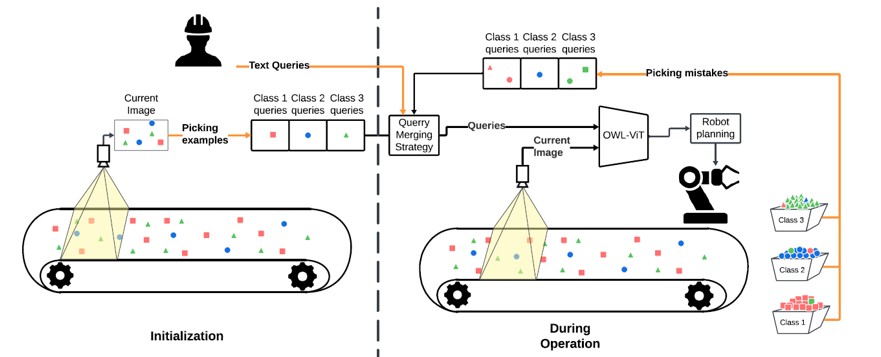

Classificatie en manipulatie zijn cruciaal in sectoren als recycling, manufacturing en logistics. In de metal recycling heeft versnipperd materiaal allerlei vormen en soorten materiaal, wat het een van de meest uitdagende omgevingen maakt voor industriële machine vision. Klassiek gezien begint gegevensverzameling met het selecteren van de juiste sensoren of camera’s om nauwkeurige visuele input te garanderen. Traditionele deep-learning methoden vereisen uitgebreide data labeling en training, wat ze kostbaar en inflexibel maakt. Hierdoor kunnen process operators vaak geen kleine aanpassingen doen.

Vooruitgang in data analysis heeft geleid tot aanpasbare AI-modellen die realtime leren en flexibele objectdetectie met minimale training mogelijk maken. Voor de metaal sorteer casus zijn tien verschillende modellen geëvalueerd: YOLOv8, Faster-RCNN-resnet50 en resnet101, SSD, RT-DETR I en X, OWL-ViT met text en image, ViTB16 + SVM en NN. Deze modellen zijn beoordeeld op hun detectieprestaties bij objecten als warmtewisselaars, condensatoren en printplaten (PCB’s), en metalen zoals brons, lood, roestvrij staal, aluminium, koper en messing – zowel met als zonder datasets en met minimale tot geen training.

Actuatie speelt een sleutelrol door de implementatie van robotische manipulatie om de gedetecteerde objecten efficiënt te sorteren. De integratie van real-time sensoren en actuatie zorgt voor een naadloze samenwerking tussen AI-gestuurde visiesystemen en robotacties, wat automatisering, nauwkeurigheid en efficiëntie verbetert.

De vergelijking van de algoritmen is beschikbaar gesteld via het EFRO R&D-project in samenwerking met Riwald, RIWO, TValley en de onderzoeksgroep Smart Mechatronics and Robotics (SMART) van Saxion.